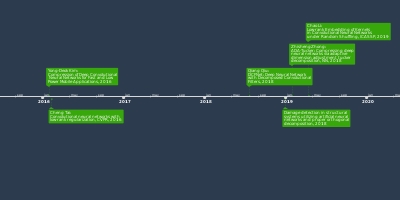

1 feb 2016 anni - Yong-Deok Kim: Compression of Deep Convolutional Neural Networks for Fast and Low Power Mobile Applications, 2016

Descrizione:

尽管最新的高端智能手机拥有强大的CPU和GPU,但在移动设备上运行更深层次的卷积神经网络(CNN)来完成复杂的任务(如图像网分类)是一项挑战。为了在移动设备上部署深度CNN,我们提出了一种简单有效的压缩整个CNN的方案,我们称之为一次全网压缩。该方案包括三个步骤:(1)采用变分贝叶斯矩阵因式分解的秩选择;(2)核张量上的塔克分解;(3)通过微调恢复累积的精度损失,每个步骤都可以使用公共工具轻松实现。我们通过在智能手机上测试各种压缩CNN(Alexnet、VGGS、Googlenet和VGG-16)的性能来证明该方案的有效性。模型尺寸、运行时间和能耗都得到了显著的降低,但精度损失很小。此外,我们还讨论了重要的实施级别问题1?1卷积是我们提出的方案压缩的谷歌公司初始模块和CNN的关键操作。Aggiunto al nastro di tempo:

Data:

1 feb 2016 anni

Adesso

~ 9 years and 8 months ago